サービス概要

生成AIを活用したWebサービスやシステムの脆弱性を診断します。従来のWeb脆弱性診断では検出できない生成AI固有の脆弱性を国際基準を用いた診断で検出し、セキュリティリスクを可視化します。

-

インプット

ドメイン・URL

認証情報

ソースコード(オプション) -

診断

国際標準に基づいた診断

(OWASP Top10 for LLM Applications) -

アウトプット

生成AIアプリケーションの

脆弱性と改善提案

主な診断項目

OWASP Top10 for LLM Applications※に沿った診断を実施

※ OWASP Top 10 for Large Language Model Applications

OWASP Top10 for LLM Applications 2025

の項目例

- LLM01:プロンプトインジェクション

- LLM02:機密情報の漏洩

- LLM03:サプライチェーン

- LLM04:データとモデルポイズニング

- LLM05:不適切な出力処理

- LLM06:過剰な自律性

- LLM07:システムプロンプトの漏洩

- LLM08:ベクトルと埋め込みの脆弱性

- LLM09:誤情報

- LLM10:際限のない消費

SHIFT SECURITYの生成AIシステム活用診断は、

通常のWebアプリケーション診断のプランと

組み合わせ可能です。

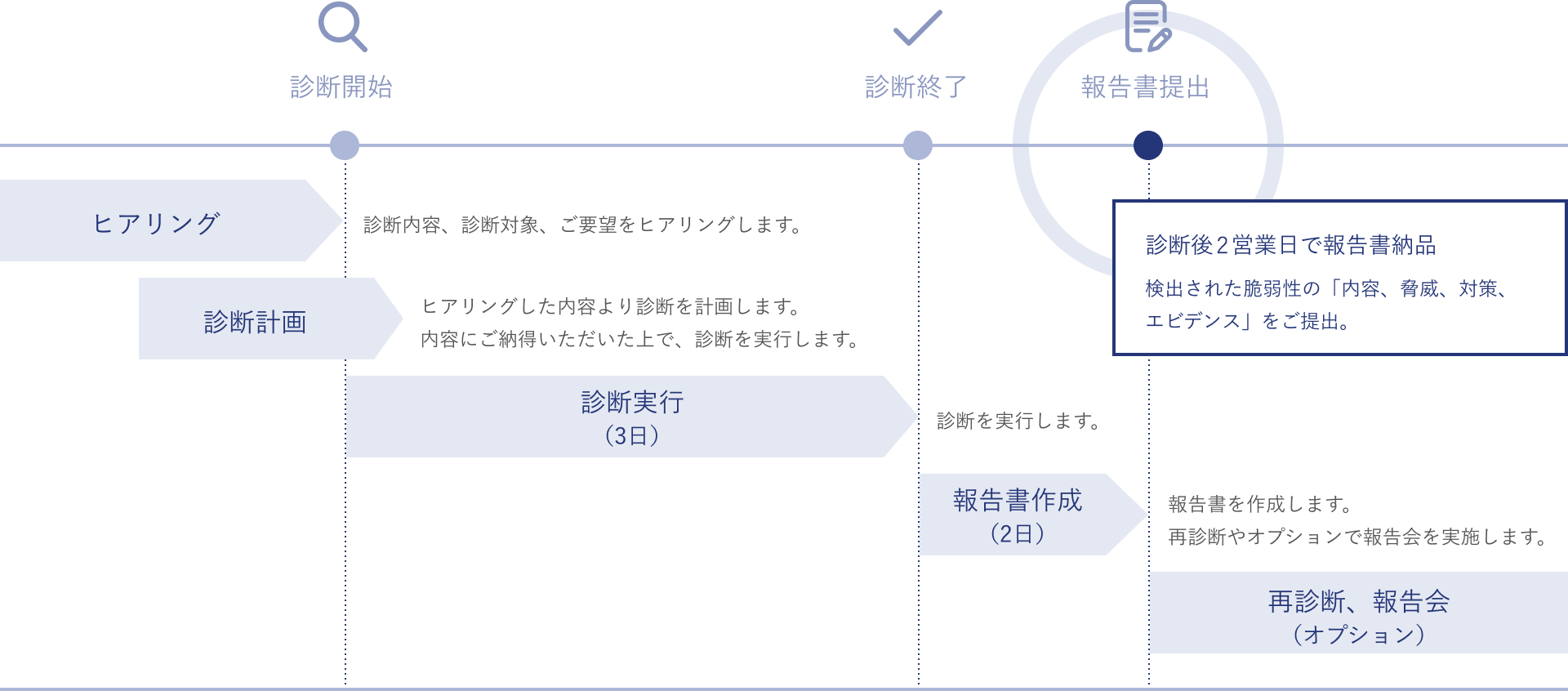

診断スケジュール例

診断実行日数が5日間の準委任の場合

よくある質問

-

具体的にどのような生成AI固有のリスクがありますか?

-

生成AI固有のリスクの代表例としてはプロンプトに対する攻撃があります。プロンプトとは生成AIへの依頼を記したテキストを指します。意図しないテキストでプロンプトを構築され、意図しない動作を引き起こしてしまう場合があります。典型的な攻撃例としては、本来は利用者に表示されないはずのプロンプト自体を出力させる行為などがあります。

-

独自の学習データは利用していないので、生成AIに関する診断は不要ですか?

-

独自データを利用していない場合も診断の実施を推奨いたします。独自のモデル構築やファインチューニングなどの独自の学習を利用しない場合でも、生成AI利用には固有のリスクが生じます。OWASP Top10 for LLM Applicationsの観点にはトレーニングデータの汚染がありますが、それ以外の観点は独自の学習データに関わらず注意する必要があるため、診断の実施を推奨しています。

-

生成AI活用システム診断はブラックボックステストで実施可能ですか?

-

ブラックボックステストでの実施が可能です。また、診断対象のソースコードを提供可能な場合は一部観点をホワイトボックスにて評価することも可能です。提供不可の場合はヒアリングとブラックボックステストの範囲で診断を実施します。